本記事は Kong Blog の記事を翻訳し転載しています。

Marco Palladino

CTO and Co-Founder

はじめに

私たちの世界における AI と LLM の台頭は、私たちが構築するアプリケーションと提供するカスタマーエクスペリエンスに革命をもたらしています。これは、テクノロジーの進化における交差点を越え、パラダイムシフトを伴う新たな旅に出るという、この業界における極めて重要な瞬間のひとつです。過去の交差点には、モバイルの台頭、クラウドの台頭、マイクロサービスの台頭などがありました。AI はインターネットの誕生と同じくらい革命的だと言う人さえいるかもしれません。

Kong 社の CTO として API の世界に携わっている私は、AI の利用が API をバックボーンとして推進されていることに気づかずにはいられません。その理由は:

- 私たちが AIを用いるときは、APIを介して行います。それはブラウザにプロンプトが表示される場合でも同様です。

- AI は世界中からの情報収集に API を用います。多くの製品やサービスがAIの利用を望むようになれば、それに伴って API の数も加速度的に増加します。

そのため、API の長期的な追い風は AI の導入によってさらに強化されています。現在、インターネットトラフィックの 83% 以上が API トラフィックです。AI トラフィックという新たなカテゴリーができた今、API トラフィックは今後数年でどれだけ増加するのか、またそのうちどれだけが AI に関連するトラフィックになるのか気になります。今日の API トラフィックの大部分は、すでにモバイルやウェアラブルデバイスのようなブラウザ以外のエクスペリエンスによってもたらされています。AI は、世界の新規 API トラフィックの大部分を占めるようになるでしょう。

AI の導入

当社の製品で AI を使い始めるには、世界中の開発者や組織が新たなベストプラクティスを開発し、新たな技術を導入して、AI の消費がどのように管理され、保護されるかを根本的に確立する必要があります。

この点で取り組むべき観点は多くあります:

- AI とデータセキュリティ:顧客データや機密データが AI/LLM に入力され、プライバシーの漏洩、セキュリティのエスカレーション、潜在的なデータ侵害が引き起こされるのを防ぐ必要があります。

- AI ガバナンス:組織で生成される AI トラフィックを管理、保護、監視するための単一のコントロールプレーンを使用して、アプリケーションとチームがどのように AI を消費しているか、すべてのプロバイダーとモデルにわたって管理できるようにする必要があります。このレベルの可視性と制御を提供する AI のためのコントロールプレーンがなければ、組織は、チームが自社の製品にどのように AI を導入しているのか、また正しい方法で導入しているのかがわからなくなってしまいます。

- マルチ AI の導入:業務に最適な AI を活用すれば、さまざまな LLM やモデルの統合にかかる時間を短縮することができるはずです。ジェネラリスト LLM とスペシャリスト LLM は、さまざまなタスクに対応するために導入され、開発者は要件に基づいてさまざまなクラウドホスト型またはオープンソース型を導入することができ、OSS 型は性能とインテリジェンスで急速に追い上げています。

組織内で AI の導入が進むにつれ、開発者が AI 使用に関する特定の横断的な懸念に対処することなく、迅速に反復し、新しい機能を構築できるようにしたいと考えています。したがって、アプリケーション チームの生産性を向上させ、組織内で AI を安全かつ責任を持って活用するためには、AI を組織のコア プラットフォームによって提供されるサービスにし、AI を使用する可能性のあるあらゆる製品から利用できるようにする必要があります。そうすることで、チーム全体で AI を導入する際に、ことわざにあるような車輪の再発明を避けることができます。

AI Gateway パターンの紹介

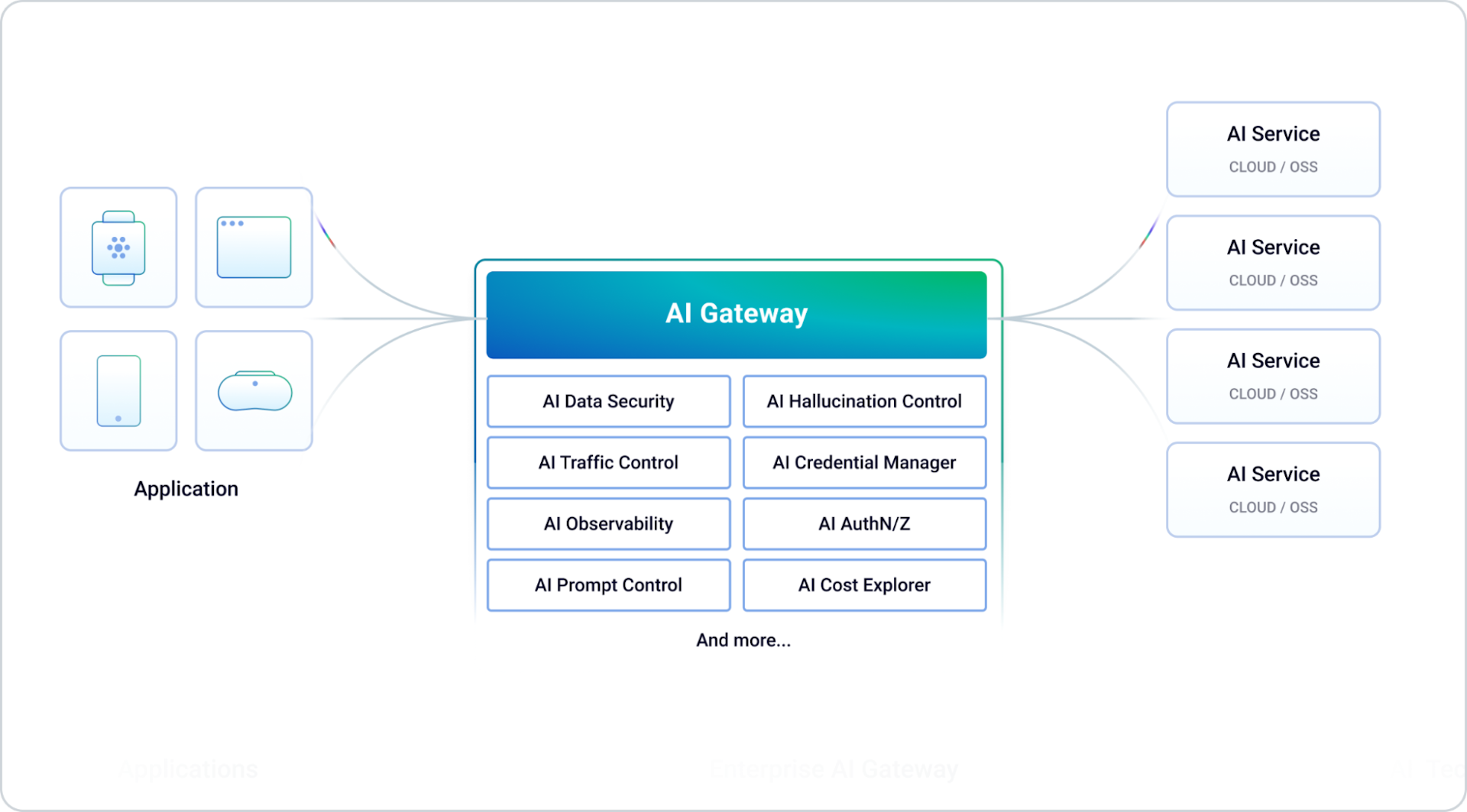

適切なレベルの可観測性、セキュリティ、ガバナンスを備えた組織での AI の導入を加速させるために、組織は開発者が使用したいと考えるあらゆる LLM やモデルへの分散型 AIの egress を提供する AI Gateway の導入を開始します。これにより、AI モデルがクラウドでホストされているか、セルフホストされているかにかかわらず、すべてのチームの AI 消費を一元管理できるようになりました。

AI Gateway は、従来の API Gateway と同様の方法で動作します:つまり、内部 API を他のクライアントに公開するリバースプロキシとして動作する代わりに、アプリケーションによって生成された AI トラフィックの egress プロキシとしてデプロイされます。このトラフィックは、バックエンドの AI モデルがホストされている場所(クラウドまたはセルフホスト)に応じて、組織の内部または外部に送信されます。

組織内で AI の導入が進むにつれ、すべてのアプリケーションで同じ横断的な懸念事項に対処することなくイノベーションを起こせるよう、チームを加速させる必要があります。AI Gateway がなければ、複雑化、断片化、セキュリティの盲点、シャドー IT 、そして全体的な効率低下とコスト上昇を招く危険性があります。

API の横断的な懸念に対応するために API Gateway を導入するのと同じように、すべての AI 消費に対して対応するために AI Gateway を導入します。アーキテクチャをシンプルにするために、理想的には、 AI Gateway はプラットフォーム チームによって管理され、それを使用する必要があるすべてのアプリケーションに内部コアサービスとして提供されます。これは、組織で生成されたすべての AI 消費を管理するための統一されたコントロールプレーンを提供するという利点があり、したがって、セキュリティポリシーや可観測性の収集をより迅速に実装し、異なるチームがアプリケーションで AI にアクセスする必要があるときはいつでも、オンボーディングを自動化するための開発者パイプラインを実装する可能性があります。

AI Gateway は、複数の AI バックエンド( OpenAI 、Mistral 、LLaMA 、Anthropic など)をサポートしますが、開発者が必要な AI モデルにアクセスするために使用できる API インターフェイスは 1 つだけ提供されます。あらゆる AI バックエンドのセキュリティ認証情報を一元管理できるようになり、サードパーティ AI への認証情報を変更または取り消すたびに、アプリケーションを更新する必要がなくなりました。

そして、プロンプトのセキュリティ、検証、およびテンプレート生成を実装し、プロンプト自体を1つのコントロールプレーンで管理し、クライアントアプリケーションを更新することなく変更できます。プロンプトは AI に求める処理の核心であり、アプリケーションが生成できるプロンプトを制御できるようにすることは、責任ある方法で、コンプライアンスに準拠した AI の導入に不可欠です。私たちは、開発者が制限されたトピック(例えば政治的なトピック)を中心に AI 統合を構築したり、プロンプトに誤って間違ったコンテキストを設定したりして、後に悪意のあるユーザーに悪用されたりすることは望んでいません。

異なるチームが異なる AI サービスを使用する可能性が高いため、AI Gateway は、複数のモデルを利用するための標準化されたインターフェースを提供することができ、異なるモデル間での AI の実装を簡素化し、さらにモデル間の切り替えを簡素化することができます。

AI Gateway はまた、AuthN/Z 、レート制限、完全な API ライフサイクルガバナンスのようなセキュリティオーバーレイを実装し、AI がチーム内部でどのようにアクセスされているかをさらに管理することもできます。結局のところ、AI トラフィックは API トラフィックなのです。

AI の観測可能性を一元管理でき、サードパーティのログ/メトリクス コレクターに送信することもできます。また、一か所で構成されているため、生成される AI トラフィック全体を簡単にキャプチャして、データがコンプライアンスに準拠しているか、使用状況に異常がないかをさらに確認することができます。

最後に重要なことですが、誰もが知っているように、AI モデルの実行にはかなりのコストがかかります。AI Gateway を活用できるようになることで、組織は AI の利用状況から学習し、コスト削減の取り組みや最適化を実施できるようになります。

結論

GenAI と LLM テクノロジーの最近の発展が牽引する人工知能は、業界を破壊し、すべての組織が顧客のために構築しているアプリケーションのエクスペリエンスを永遠に変える可能性がある、10年に一度のテクノロジー革命です。

API は常に新しいユースケース(モバイル革命、マイクロサービスなど)に牽引されてきましたし、AI は世界の API トラフィックの量をさらに増加させます:我々のアプリケーションが AI モデル自身と通信するために使用する API 、あるいは AI モデルが世界と対話するために使用する API なのです。

AI の消費は難しい。異なるアプリケーション間で共有可能なモデルを使用する場合、そしておそらく異なる組織間で共有する場合、データコンプライアンスに重大な影響が生じます(共有環境でホストされるフルマネージドクラウドモデルを考えてください)。

さらに、AI トラフィックは、組織の内外から来る他のすべてのタイプの API トラフィックに対してすでに行っているのと同様に、セキュリティーを保護し、管理し、監視する必要があります。本番環境で AI を使用するには、多くのインフラを整備する必要があることがわかりました。

AI Gateway があれば、AI インフラや AI に必要なすべての横断的機能の構築を求めることなく、開発者が迅速かつセルフサービスで AI を利用できるよう、すぐに使えるソリューションを提供できます。

AI Gateway を導入することで、組織はすべてのチームとすべてのアプリケーションによって生成されるAI トラフィックを完全に制御できるという安心感を得ることができます。そして、AI がコンプライアンスを遵守し、責任ある方法で使用されていることを保証するための適切な抽象化がようやく整ったのです。

関連記事

2022.09.13Grafana翻訳記事インシデント管理のための Grafana Incident を Grafana Cloud で一般公開

2022.09.13Grafana翻訳記事インシデント管理のための Grafana Incident を Grafana Cloud で一般公開 2022.11.29Kong翻訳記事Kong、「Red Hat OpenShift Service on AWS(ROSA)」「AWS Graviton Processor」「Bottlerocket OS Readiness」を発表

2022.11.29Kong翻訳記事Kong、「Red Hat OpenShift Service on AWS(ROSA)」「AWS Graviton Processor」「Bottlerocket OS Readiness」を発表 2024.06.03GrafanaProduct Releases翻訳記事Grafana Tempo 2.5 リリース:vParquet4、ストリーミング エンドポイントおよび、その他のメトリクス

2024.06.03GrafanaProduct Releases翻訳記事Grafana Tempo 2.5 リリース:vParquet4、ストリーミング エンドポイントおよび、その他のメトリクス 2022.12.07HERE翻訳記事アマゾン・ロケーション・サービスのHEREマップ

2022.12.07HERE翻訳記事アマゾン・ロケーション・サービスのHEREマップ